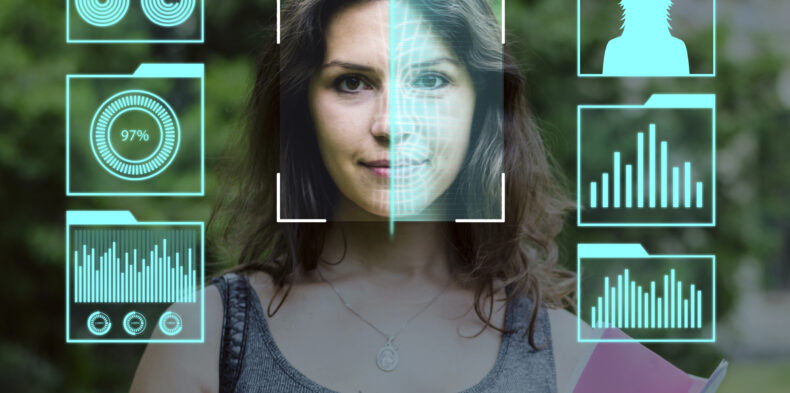

Coraz więcej działów HR wykorzystuje AI w rekrutacji do selekcji aplikacji kandydatów. Znacznie rzadziej analizuje się jednak, kto ponosi odpowiedzialność za sytuację, w której decyzja algorytmu zostaje zakwestionowana. A to – wbrew pozorom – scenariusz, z którym firmy będą mierzyć się coraz częściej.

Wobec kandydata zawsze odpowiada pracodawca

Wyobraźmy sobie sytuację: spółka X, średniej wielkości firma usługowa, wdrożyła narzędzie AI do wstępnej selekcji CV. Po kilku tygodniach odrzucony kandydat (np. 55-latek) zarzuca firmie dyskryminację ze względu na wiek. Pierwsza myśl zarządu: „To AI podjęło decyzję, nie my”. To błędne założenie, bo algorytm nie jest stroną postępowania, a jest nią firma, która prowadzi proces rekrutacyjny.

W tym miejscu należy wspomnieć o AI Act, czyli unijnym rozporządzeniu, które określa ramy regulacyjne dla rozwoju, wdrażania i użytkowania sztucznej inteligencji na terenie Unii Europejskiej. Wbrew powszechnemu przekonaniu, nie dotyczy tylko twórców systemów AI, ale też nakłada obowiązki także na „zwykłe” firmy, które taki system u siebie wdrażają.

Systemy AI używane w rekrutacji zostały sklasyfikowane jako systemy wysokiego ryzyka, a to oznacza zestaw konkretnych wymagań, których spełnienie jest warunkiem zgodnego z prawem korzystania z takiego narzędzia. Jest to m.in. konieczność zapewnienia nadzoru człowieka nad decyzją czy informowanie kandydatów o wykorzystaniu AI w procesie rekrutacji.

Wobec kandydata zawsze odpowiada pracodawca

Zgodnie z AI Act, kandydat będzie miał prawo uzyskania jasnego i merytorycznego wyjaśnienia roli tego systemu AI w procedurze podejmowania decyzji oraz głównych elementów podjętej decyzji.

To jest obowiązek prawny, który zacznie mieć zastosowanie od 2 sierpnia 2026 r. w ramach przepisów wdrażanych etapowo.

I tu zaczyna się prawdziwy problem dla firmy, bo jeśli wśród czynników, które wpłynęły na decyzję, znajduje się wiek, czy płeć w sposób nieuzasadniony, może to stanowić dyskryminację, a to na gruncie Kodeksu pracy jest zakazane. I jeśli sztuczna inteligencja go dyskryminowała w procesie selekcji aplikacji – to tak naprawdę zrobiła to firma.

Rola HR – nadzór ludzki to nie tylko kliknięcie „akceptuję”

Rola pracowników działu HR, korzystających z narzędzi AI, jest znacznie poważniejsza, niż się może wydawać. To oni powinni dokumentować swój udział w procesie decyzyjnym, znać kryteria działania algorytmu i być w stanie odpowiedzieć kandydatowi, dlaczego jego aplikacja została odrzucona.

Dodatkowo art. 4 AI Act nakłada na pracodawców prawny obowiązek zapewnienia pracownikom, w tym rekruterom, odpowiedniego poziomu kompetencji w zakresie AI. To nie tylko dobra praktyka, ale też wymóg prawny.

Dostawca technologii: kiedy realnie ponosi odpowiedzialność?

Czy zatem dostawca AI jest poza odpowiedzialnością? Niekoniecznie, ale jego rola pojawia się dopiero w drugim kroku – w relacji firma-dostawca, a nie firma-kandydat. Jeżeli błąd wynika z wady konstrukcyjnej narzędzia, np. stronniczego algorytmu, pracodawca może próbować dochodzić roszczeń od dostawcy narzędzia AI.

Jednak jeśli błąd wynikał z niewłaściwego wdrożenia, braku nadzoru lub używania narzędzia niezgodnie z jego przeznaczeniem, ciężar odpowiedzialności pozostaje po stronie pracodawcy.

Firmy powinny przygotować się już teraz

Istotne są trzy kwestie: wybór odpowiedniego dostawcy i narzędzia, ustanowienie wewnętrznych procedur nadzoru nad rekomendacjami algorytmu i realne szkolenia rekruterów.

Bo jeśli algorytm niesłusznie odrzuci kandydata, to nie sztuczna inteligencja stanie przed sądem, a firma.

Te kroki należy podjąć już teraz, bo jeśli odrzucony kandydat zacznie zadawać pytania, odpowiedź firmy nie może brzmieć: „przecież to AI zdecydowało”.

________________________________

autorka komentarza: Marietta Poźniak: radca prawny, ekspertka ds. AI w organizacjach. Absolwentka studiów podyplomowych z prawa sztucznej inteligencji na Akademii Leona Koźmińskiego (z wyróżnieniem). Certyfikowany audytor wewnętrzny ISO/IEC 42001. Twórczyni marki rozwijAI https://rozwijai.com/– szkoli firmy z bezpiecznego i zgodnego z prawem korzystania z AI w pracy. LinkedIn: www.linkedin.com/in/mariettapozniak